Optimización de Recursos en Kubernetes con Request y Limits

Apasionado por la tecnología con más de 10 años de experiencia. Actualmente trabajando con tecnologías Cloud y Devops.

☁️ AWS Certified Solutions Architect – Associate ☁️ AWS Certified Security – Specialty

En el ecosistema de Kubernetes, optimizar el uso de recursos es fundamental para garantizar un rendimiento eficiente y confiable de las aplicaciones desplegadas. Dos conceptos clave para lograr esta optimización son Request y Limits. En este artículo, no solo exploraremos en detalle estos conceptos, sino que también abordaremos otras estrategias y consideraciones importantes para optimizar el desempeño en Kubernetes en el entorno de AWS.

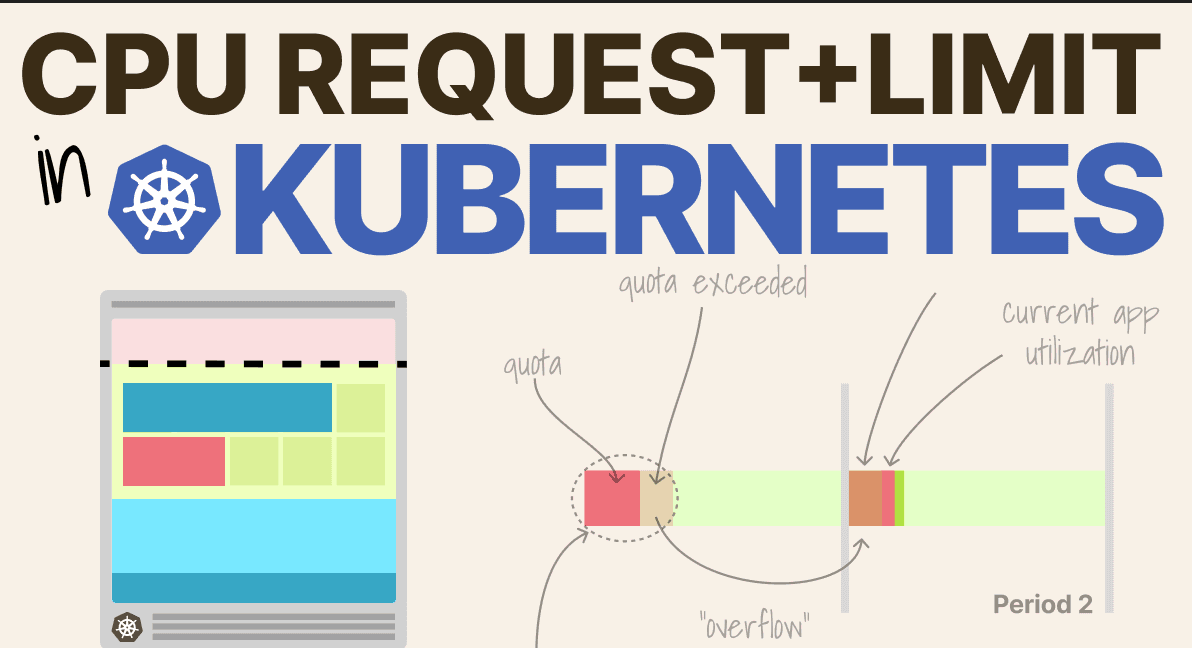

Request y Limits en Kubernetes: ¿Qué son y cómo funcionan?

Request: Representa la cantidad mínima de recursos que un contenedor necesita para funcionar adecuadamente. Kubernetes reserva estos recursos en el nodo donde se ejecuta el contenedor, asegurando que siempre estén disponibles para su uso.

Limits: Define la cantidad máxima de recursos que un contenedor puede consumir. Kubernetes utiliza los límites para controlar el uso excesivo de recursos, lo que ayuda a prevenir la degradación del rendimiento del clúster y la competencia por recursos entre los contenedores.

Estos conceptos son esenciales para garantizar una distribución eficiente de los recursos en el clúster de Kubernetes, evitando el sobreaprovisionamiento o la subutilización de recursos, lo que puede afectar negativamente la escalabilidad y la estabilidad de las aplicaciones.

Ejemplo Práctico con Código

Supongamos que tenemos un despliegue en Kubernetes de una aplicación de análisis de datos que requiere un mínimo de 1 CPU y 2 GB de memoria para funcionar correctamente, pero no debe consumir más de 2 CPU y 4 GB de memoria en ningún momento.

yamlCopy codeapiVersion: apps/v1

kind: Deployment

metadata:

name: mi-aplicacion-analisis

spec:

replicas: 3

selector:

matchLabels:

app: mi-aplicacion-analisis

template:

metadata:

labels:

app: mi-aplicacion-analisis

spec:

containers:

- name: analisis-datos

image: mi-imagen-de-analisis:latest

ports:

- containerPort: 8080

resources:

requests:

cpu: "1"

memory: "2Gi"

limits:

cpu: "2"

memory: "4Gi"

Más Estrategias para Optimizar en AWS

Además de configurar Request y Limits en Kubernetes, existen otras estrategias y consideraciones importantes para optimizar el rendimiento en el entorno de AWS:

Elastic Load Balancing: Utiliza ELB para distribuir el tráfico de manera uniforme entre las instancias de tu aplicación, garantizando una alta disponibilidad y escalabilidad.

Auto Scaling Groups: Configura grupos de escalado automático para ajustar dinámicamente la capacidad de tus aplicaciones en función de la demanda, optimizando los costos y garantizando un rendimiento constante.

Utilización de Instancias Reservadas: Aprovecha las instancias reservadas de EC2 para reducir los costos operativos, especialmente para cargas de trabajo predecibles y de larga duración.

Optimizar el uso de recursos en Kubernetes, especialmente en el entorno de AWS, es fundamental para garantizar un rendimiento eficiente y rentable de las aplicaciones desplegadas. Configurar adecuadamente Request y Limits en Kubernetes es solo el primer paso. Combinado con otras estrategias de optimización en AWS, puedes garantizar una infraestructura escalable, confiable y rentable para tus aplicaciones en la nube.

Con estas estrategias y consideraciones en mente, estás listo para optimizar el rendimiento de tus aplicaciones en Kubernetes en AWS, maximizando la eficiencia y brindando una experiencia excepcional a tus usuarios.